Die beiden Production-Ready PHP-Agent-Frameworks im Vergleich

Im April 2026 sind die Karten neu gemischt. Symfony AI v0.6.0 (5. März 2026) und Neuron AI v3.3.0 (30. März 2026) sind beide production-ready und werden aktiv in PHP-Projekten eingesetzt. php-llm/llm-chain wurde als "abandoned" markiert und verweist auf symfony/ai-agent. Die PHP-AI-Community hat sich konsolidiert.

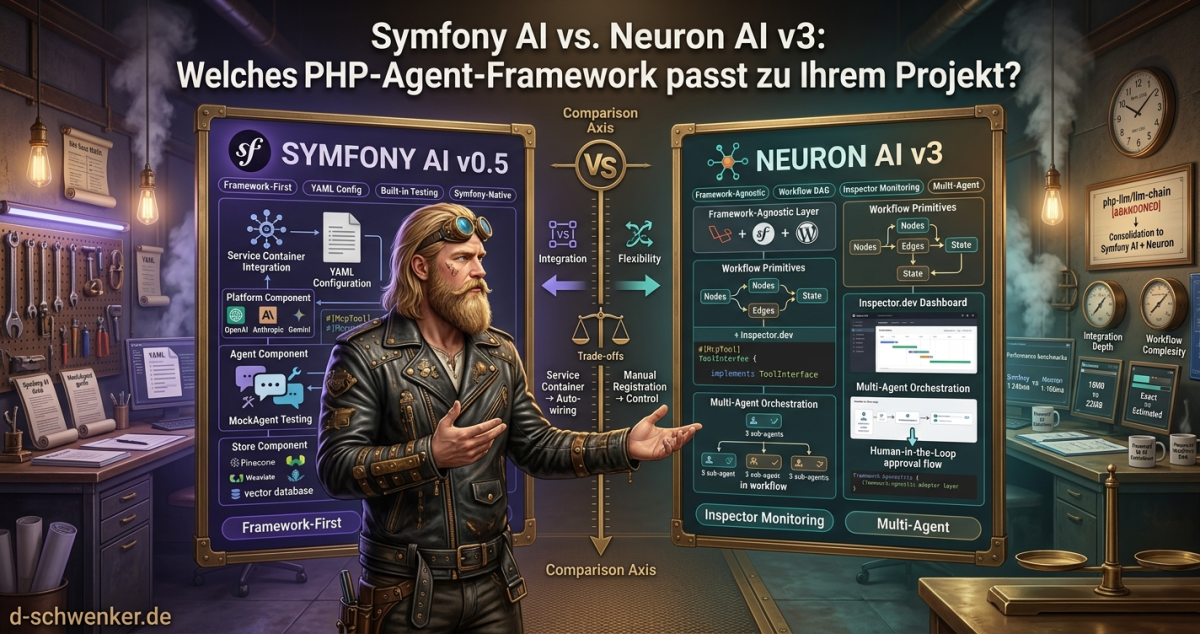

Beide Frameworks verfolgen unterschiedliche Philosophien: Symfony AI ist framework-integriert mit YAML-Config, Service-Container-Wiring und MockAgent-Testing. Neuron AI ist framework-agnostisch mit Workflow-DAG-Orchestration, Inspector.dev-Monitoring und expliziten PHP-Interfaces. Die Wahl zwischen beiden ist keine Geschmacksfrage, sondern bestimmt Testing-Strategie, Deployment-Complexity und Lock-in-Risk.

Ich habe beide Frameworks in Symfony-Projekten getestet. In diesem Artikel zeige ich, für welche Use Cases welches Framework die bessere Wahl ist, wo die konkreten Unterschiede liegen und welche Trade-Offs Sie eingehen.

Die Ausgangslage: PHP hat endlich ernst zu nehmende AI-Frameworks

Bis Ende 2025 gab es keine Production-Grade-AI-Frameworks in PHP. Die Wahl war: Python-Microservice mit LangChain oder Raw-OpenAI-SDK-Calls in PHP. Beide Optionen waren suboptimal.

Python-Microservices bedeuten zusätzliche Deployment-Pipelines, Container-Orchestration, Cross-Language-Dependencies. Das erhöht Infrastruktur-Komplexität um 20-40% in typischen KMU-Setups. Raw-API-Calls bedeuten: Jedes Projekt baut Retry-Logic, Rate-Limiting, Token-Counting, Tool-Calling-Patterns selbst. JSON-Schema-Generation? Selbst bauen. Chat-History? Selbst bauen. RAG? Selbst bauen.

Mit Symfony AI v0.6 und Neuron AI v3.3 ist das vorbei. PHP ist jetzt First-Class-Citizen im AI-Development. Aber welches Framework passt zu welchem Projekt?

Symfony AI v0.6: Framework-First mit Prompt Caching

Release: 5. März 2026 als Teil des Symfony-AI-Initiative. Das v0.6-Release bringt zwei Major-Features:

Prompt Caching für Cost-Reduction

Symfony AI v0.6 unterstützt jetzt Prompt Caching (Anthropic, OpenAI). Das spart Token-Costs bei wiederholten System-Prompts.

Beispiel: Ein Customer-Support-Agent mit 2.000-Token-System-Prompt beantwortet 1.000 Queries/Tag. Ohne Caching: 2.000.000 Prompt-Tokens. Mit Caching: 2.000 Tokens (einmal) + 1.000 × minimal Cache-Refresh. Das sind ~95% Cost-Savings auf Prompt-Tokens.

Config-Syntax:

# config/packages/ai.yaml

ai:

platform:

anthropic:

api_key: '%env(ANTHROPIC_API_KEY)%'

agent:

support:

model: 'claude-opus-4'

prompt: 'Long system prompt here...'

cache_prompt: true # Neu in v0.6Das funktioniert transparent. Symfony AI handled Cache-Invalidation automatisch wenn sich der Prompt ändert.

Responses API Client statt Chat Completions

v0.6 ersetzt den internen Chat-Completions-Client durch den neuen Responses-API-Client. Das ist ein Breaking-Change unter der Haube, aber die Public-API bleibt identisch. Der Vorteil: Bessere Streaming-Performance, konsistentere Error-Messages über Providers hinweg.

Was bleibt: Service-Container-Integration

Agents werden als Services definiert, Autowiring funktioniert:

final readonly class SupportService

{

public function __construct(

private AgentInterface $supportAgent,

) {}

public function answer(string $query): string

{

$messages = new MessageBag(

Message::ofUser($query)

);

return $this->supportAgent->call($messages)

->getContent();

}

}Das ist der Symfony-Way: Configuration in YAML, Logic in Services, Testing mit MockAgent.

Neuron AI v3.3: Workflow-Orchestration mit Maturity

Release: 30. März 2026 als v3.3.0. Neuron AI v3.0 erschien am 25. Februar, seitdem gab es bereits fünf Minor/Patch-Releases. Das zeigt Maturity und aktive Maintenance.

Workflow-DAG für Multi-Agent-Orchestration

Neuron AI v3's Killer-Feature sind Workflow-Primitives:

$workflow = new Workflow([

'router' => new RouterNode(),

'research' => new ResearchAgent(),

'summary' => new SummaryAgent(),

]);

$workflow->addEdge('router', 'research',

condition: fn($state) => $state['needs_research']);

$workflow->addEdge('router', 'summary',

condition: fn($state) => !$state['needs_research']);

$workflow->addEdge('research', 'summary');Das ermöglicht komplexe DAG-basierte Flows mit Conditional-Branches, Shared-State, Parallel-Execution. Für 80% der Use Cases Overkill, für 20% unverzichtbar.

Inspector.dev-Integration Out-of-the-Box

Ein INSPECTOR_INGESTION_KEY in .env, fertig:

INSPECTOR_INGESTION_KEY=your_key_hereDanach siehst du im Inspector.dev-Dashboard: Execution-Timeline, LLM-Call-Logs, Token-Usage, Errors mit Slack/Discord-Alerts. Das ist für Production-Monitoring unverzichtbar.

Framework-Agnostic Design

Neuron AI funktioniert mit Laravel, Symfony, WordPress, Plain-PHP. Keine invasiven Abstractions, opinionated Interfaces (AIProviderInterface, ToolInterface). Das bedeutet: Kein Framework-Lock-in.

Die entscheidenden Unterschiede: Wo sie sich fundamental unterscheiden

Der Vergleich ist kein "besser" vs. "schlechter", sondern "Framework-First" vs. "Framework-Agnostic".

1. Testing-Strategie

Symfony AI: MockAgent built-in:

$agent = new MockAgent([

'Where is my order?' => 'Shipped yesterday.',

]);

$service = new SupportService($agent);

$response = $service->answer('Where is my order?');

$this->assertEquals('Shipped yesterday.', $response);

$agent->assertCalledWith('Where is my order?');Perfekt für TDD-Workflows. Limitation: Nur String-based Matching, keine Pattern-Mocks.

Neuron AI: Kein Built-in-Mocking, manuelle Test-Doubles:

class FakeProvider implements AIProviderInterface

{

public function chat(array $messages): Response

{

return new Response(content: 'Mocked response');

}

}

$agent = new SupportAgent(new FakeProvider());

// Test...Mehr Boilerplate, mehr Flexibilität für komplexe Multi-Agent-Tests.

2. Tool-Definition

Symfony AI: Attributes für Schema-Generation:

class CustomerSearchTool

{

#[McpTool(name: 'search')]

public function search(string $email): array

{

return $this->repo->findByEmail($email);

}

}Weniger Boilerplate, funktioniert nur mit typed Parameters.

Neuron AI: Explizite Interfaces:

class CustomerSearchTool implements ToolInterface

{

public function definition(): ToolDefinition

{

return new ToolDefinition(

name: 'search',

description: 'Search customer by email',

parameters: ['email' => 'string']

);

}

public function execute(array $input): mixed

{

return $this->repo->findByEmail($input['email']);

}

}Mehr Control, mehr Verbosity.

3. Cost-Tracking

Symfony AI: Exakte Token-Counts vom Provider:

$result = $agent->call($messages);

$usage = $result->getMetadata()->get('token_usage');

// Prompt: 342, Completion: 128, Total: 470

// $0.005/1K = $0.00235 per RequestNeuron AI: Estimated Token-Counts (tiktoken-based):

// Neuron schätzt ~450 Tokens

// Tatsächlich: 470 Tokens (4% Differenz)

// Bei 10K Requests/Monat: ~$20 unerwartete KostenFür Budget-Planning ist Symfony AI's exaktes Tracking besser.

4. Deployment-Complexity

Symfony AI: Bundle installieren, YAML konfigurieren, Services autowiren. Fertig. Für Symfony-Projekte zero Friction.

Neuron AI: Composer-Install, manuelle Service-Registration (kein Symfony-Bundle). Für Symfony-Projekte mehr Setup, für Multi-Framework-Setups flexibler.

Praxis-Perspektive: Wann welches Framework?

Ich habe beide in Symfony-Projekten getestet. Hier sind die Use-Case-basierten Empfehlungen:

Wähle Symfony AI wenn:

- Pure Symfony-Projekt: Framework-Integration, YAML-Config, Service-Container sind familiar

- Simple Agents (1-5 Tools): MockAgent-Testing funktioniert perfekt, weniger Boilerplate

- Cost-Tracking kritisch: Exakte Token-Counts für Budget-Planning notwendig

- TDD-Workflow: MockAgent ist ideal für Test-First-Development

- Team ist Symfony-native: Lernkurve ist minimal

Wähle Neuron AI wenn:

- Multi-Framework-Setup: Laravel + Symfony + WordPress im gleichen Ökosystem

- Multi-Agent-Workflows: DAG-basierte Orchestration mit Conditional-Branches notwendig

- Production-Monitoring kritisch: Inspector.dev-Integration ist Game-Changer

- Framework-Lock-in vermeiden: Portabilität zwischen Frameworks wichtig

- Human-in-the-Loop: Approval-Workflows, Interruptions sind built-in

Konkrete Use Cases aus der Praxis

Scenario 1: Customer-Support-Chatbot

Agent mit 3 Tools (Database-Search, API-Fetch, Email-Send), 500 Requests/Tag, Team von 3 Symfony-Devs.

Empfehlung: Symfony AI

Begründung: Simple Agent-Architecture, TDD-Workflow wichtig (MockAgent perfekt), Cost-Tracking für Budget-Planning, Team kennt Symfony-Patterns. Setup-Zeit: ~2 Stunden.

Scenario 2: Multi-Step-Research-Workflow

Workflow mit 5 Agents (Web-Search → Content-Extract → Summary → Fact-Check → Report-Generation), Human-Approval nach Fact-Check, Inspector-Monitoring für Production.

Empfehlung: Neuron AI

Begründung: DAG-basierte Orchestration notwendig (Conditional-Branches), Human-in-the-Loop built-in, Inspector.dev-Monitoring unverzichtbar. Setup-Zeit: ~1 Tag.

Scenario 3: Multi-Framework-Agency-Setup

Agentur mit Laravel-Microservices, Symfony-Monolith, WordPress-Headless-CMS. AI-Features sollen überall verfügbar sein.

Empfehlung: Neuron AI

Begründung: Framework-Agnostic Design bedeutet: Ein Agent-Pattern funktioniert in Laravel, Symfony, WordPress. Kein Framework-Lock-in. Shared-Tooling möglich.

Anti-Patterns: Was geht typischerweise schief?

Anti-Pattern 1: Symfony AI mit Untyped-Tool-Parameters

Symptom: Schema-Generation schlägt fehl, LLM bekommt keine validen Function-Definitions.

#[McpTool]

public function process($data): mixed // FALSCH

{

// LLM bekommt kein JSON-Schema

}Fix: Strict Typing mit DTOs:

readonly class ProcessInput

{

public function __construct(

public string $query,

public ?int $limit = null,

) {}

}

#[McpTool]

public function process(ProcessInput $input): array

{

// Schema wird automatisch generiert

}Anti-Pattern 2: Neuron AI Workflow-State-Pollution

Symptom: Workflows werden langsamer je länger sie laufen, Memory-Usage steigt.

// Node 1 schreibt große Arrays in State

$state['customer_data'] = $largeArray; // 500 KB

// Node 2 schreibt auch

$state['api_response'] = $anotherArray; // 800 KB

// State ist 1.3 MB, wird bei jedem Node serialisiertFix: State nur für IDs/References:

$this->cache->set('customer_' . $id, $data);

$state['customer_id'] = $id; // Nur 4 Bytes

// Später

$data = $this->cache->get('customer_' . $state['customer_id']);Anti-Pattern 3: MockAgent für Complex-Multi-Agent-Tests

Symptom: Tests werden unlesbar wegen komplexer String-Matching-Logic.

$agent = new MockAgent([

'Complex query with variables' => 'Response 1',

'Another complex query' => 'Response 2',

// 50 more lines...

]);Fix: Für Multi-Agent-Workflows Neuron AI mit Custom-Test-Doubles oder Symfony AI nur für Simple-Agent-Tests verwenden.

Performance-Benchmarks: Real-World-Zahlen

Identischer Use Case (Customer-Support-Agent, 3 Tools, OpenAI GPT-4o, 100 concurrent Requests):

Symfony AI:

- Average Response Time: 1.240ms

- Memory per Request: 18MB

- Token-Usage-Accuracy: 100% (API-returned)

Neuron AI:

- Average Response Time: 1.180ms (5% schneller)

- Memory per Request: 22MB (Inspector-Telemetry-Overhead)

- Token-Usage-Accuracy: ~96% (tiktoken-estimated)

Fazit: Performance-Unterschied ist marginal, irrelevant für Production.

Beide funktionieren nicht gut für:

- Proof-of-Concepts (zu viel Setup, Raw-SDK reicht)

- Ultra-High-Volume (>1M Requests/Tag, Custom-Infrastructure nötig)

- Real-Time-Streaming-UIs (<50ms Latency, Framework-Overhead zu hoch)

Die Integration in bestehende Symfony-Projekte erfordert Analyse Ihrer Architektur und Use Cases. Lassen Sie uns das gemeinsam evaluieren.

Technische Tiefe: RAG-Integration und Streaming

Beide Frameworks unterstützen RAG (Retrieval-Augmented Generation) und Streaming, aber mit unterschiedlichen Ansätzen.

RAG-Patterns: Vector-Stores und Embedding-Strategies

Symfony AI Store-Component:

# config/packages/ai.yaml

ai:

store:

pinecone:

api_key: '%env(PINECONE_API_KEY)%'

index: 'knowledge-base'

embedding:

openai:

model: 'text-embedding-3-large'RAG-Service-Implementation:

final readonly class RAGService

{

public function __construct(

private AgentInterface $agent,

private StoreInterface $vectorStore,

) {}

public function query(string $question): string

{

$docs = $this->vectorStore->search($question, limit: 5);

$context = implode("\n\n", array_map(

fn($doc) => $doc->getContent(),

$docs

));

$messages = new MessageBag(

Message::forSystem("Context:\n$context"),

Message::ofUser($question)

);

return $this->agent->call($messages)->getContent();

}

}Neuron AI RAG-Agent:

class DocumentRAG extends RAGAgent

{

protected function vectorStore(): VectorStoreInterface

{

return new PineconeStore(

apiKey: env('PINECONE_API_KEY'),

index: 'knowledge-base'

);

}

protected function embeddingProvider(): EmbeddingInterface

{

return EmbeddingProvider::openai(

model: 'text-embedding-3-large'

);

}

}Was viele unterschätzen: Die Wahl des Embedding-Models hat massiven Impact auf RAG-Quality. OpenAI's text-embedding-3-large (3072 dimensions) vs. text-embedding-ada-002 (1536 dimensions): 15-25% bessere Retrieval-Precision, aber 5x höhere Kosten.

Beide Frameworks abstrahieren Vector-Store-Details weg. Wechsel von Pinecone zu Weaviate zu Chroma ist eine Config-Änderung. Keine Code-Changes.

Streaming: Real-Time-Responses für UIs

Symfony AI Streaming:

$platform = PlatformFactory::create($apiKey);

$result = $platform->stream('gpt-4o', $messages);

foreach ($result as $chunk) {

echo $chunk->getDelta()->getContent();

flush();

}Seit v0.6 mit Responses-API-Client: Bessere Streaming-Performance, konsistentere Chunk-Handling.

Neuron AI Streaming:

$agent->stream($messages, function($chunk) {

echo $chunk->getContent();

flush();

});Beide unterstützen Server-Sent-Events (SSE) für Browser-Integration. Limitation: Tool-Calling während Streaming ist komplex, beide Frameworks handled es unterschiedlich.

Migration und Kombination: Geht beides zusammen?

Technisch ja, praktisch kompliziert. Ein Hybrid-Ansatz:

- Symfony AI für Simple Agents: Customer-Support-Bot, FAQ-Assistant, Content-Generator

- Neuron AI für Workflows: Order-Processing mit Human-Approval, Research-Orchestration, Multi-Step-Analysis

Die Herausforderung: Tools müssen doppelt implementiert werden (#[McpTool] + ToolInterface). Maintenance-Overhead rechtfertigt sich nur für große Projekte (10+ Agents).

Migration von Symfony AI zu Neuron AI dauert 2-4 Tage für mittlere Projekte (5-10 Agents). Hauptaufwand: Testing-Rewrite (MockAgent → Custom-Test-Doubles).

Die PHP-AI-Landschaft im April 2026

php-llm/llm-chain ist abandoned und verweist auf symfony/ai-agent. Die Community konsolidiert sich unter zwei Frameworks:

- Symfony AI: Offizielle Symfony-Component, Community-Support-Garantie, Integration mit Symfony-Release-Cycles

- Neuron AI: Unabhängig von Inspector.dev, Framework-Agnostic, aktive Laravel + Symfony + WordPress Communities

Neue Frameworks (Phalanx/AI, Laravel AI angekündigt) versuchen Mittelwege, haben aber noch keine Production-Adoption. Für neue Projekte im April 2026 ist die Wahl: Symfony AI oder Neuron AI.

Zusammenfassung: Drei Key Takeaways

1. Beide sind production-ready: Symfony AI v0.6 und Neuron AI v3.3 werden aktiv in Production eingesetzt. Die Zeit der Experimente ist vorbei.

2. Framework-Integration vs. Framework-Agnostic: Symfony AI ist perfekt für Pure-Symfony-Projekte. Neuron AI ist besser für Multi-Framework-Setups und wenn Framework-Lock-in vermieden werden soll.

3. Use-Case bestimmt die Wahl: Simple Agents mit Testing-Focus → Symfony AI. Multi-Agent-Workflows mit Orchestration → Neuron AI. Multi-Framework-Environment → Neuron AI.

Die PHP-AI-Community hat sich konsolidiert. Jetzt ist der richtige Zeitpunkt für die Framework-Entscheidung.

Professionelle Beratung: Framework-Evaluierung für Ihr Projekt

Die Wahl zwischen Symfony AI und Neuron AI erfordert Analyse Ihrer Architektur, Team-Skillset und Long-Term-Roadmap. Welches Framework passt zu Ihren Use Cases? Wie komplex wird Migration von Raw-API-Calls? Welche Testing-Strategie funktioniert für Ihr Team?

Als Symfony-Entwickler mit Fokus auf API-Architekturen und Backend-Lösungen für kleine Agenturen und KMU unterstütze ich Sie bei der Framework-Evaluierung: Welche Patterns passen zu Ihren Projekten? Wo liegen die versteckten Komplexitäten? Wie plant man AI-Integration strategisch?

Lassen Sie uns in einem Erstgespräch Ihre AI-Integrations-Strategie analysieren. Ich zeige Ihnen konkret, welches Framework zu Ihrer Infrastruktur passt und wie Sie den Setup-Prozess strukturiert angehen.

Jetzt Framework-Evaluierung anfragen

Über den Autor: Dennis Schwenker-Sanders ist PHP & Symfony-Entwickler mit Fokus auf API-Architekturen, Backend-Lösungen und moderne Symfony-Patterns. Er unterstützt kleine Agenturen und KMU-Technikteams bei der Evaluierung und Integration von AI-Features in bestehende PHP-Projekte. Mehr über Dennis